- لزلی دیکستین و ماریا اسپادا، مترجم: علی شاکر

- 1401-12-09 15:31:00

- کد مطلب : 4104

.jpg)

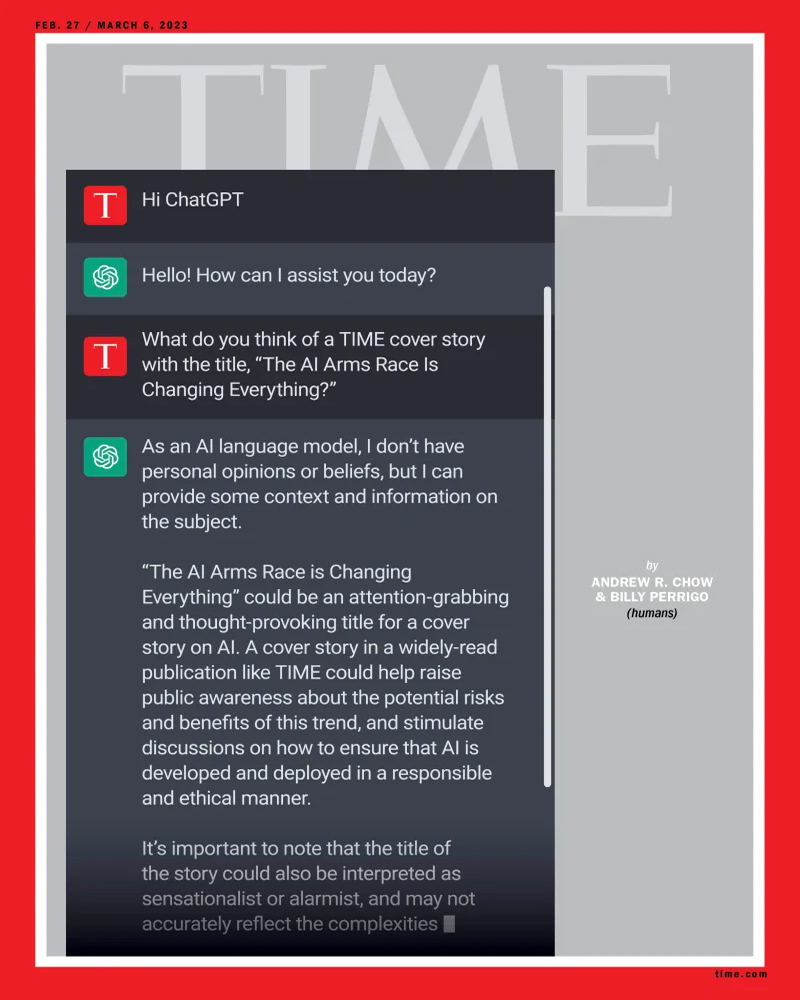

نشریه مشهور تایم (TIME) که طرح روی جلد آن همیشه مورد توجه است، این بار در ابتکاری دیگر، از ربات هوش مصنوعی ChatGPT خواسته تا نظر خود را نسبت به سرمقاله این شماره از مجله بیان کند و تصویر پاسخ این ربات را روی صفحه نخست خود کار کرده است.

در 300 هزار سال گذشته، ما در توانایی خود در خلق و ساختن هنر، آشپزی، مانیفستها، جوامعی منحصر به فرد بودهایم: یعنی تصور کردن و ساختن چیزی جدید در جایی که قبلاً هیچ چیز وجود نداشته است.

در حالی که شما در حال خواندن این جمله هستید، برنامه های هوش مصنوعی (AI) نقاشیها و پرترههای کیهانی را نقاشی میکنند، به ایمیلها پاسخ میدهند، اظهارنامه مالیاتی تهیه میکنند و آهنگهای سبک متال را ضبط میکنند.

آنها در حال تهیهی ارائههای خلاقانه (Pitch deck)، اِشکالزدایی کد، طراحی نقشههای معماری و ارائه توصیههای بهداشتی هستند.

پیشتر هوش مصنوعی تأثیری فراگیر بر زندگی ما داشته است. هوش مصنوعی برای قیمتگذاری دارو و خانهها، مونتاژ خودروها، طراحی تبلیغاتی رسانههای اجتماعی استفاده میشود. اما هوش مصنوعی مولد، که بسیار هم جدید است، سیستمی است که میتوان از آن برای ایجاد محتوای کاملاً جدید استفاده کرد.

هوش مصنوعی مولد وارد میشود

این تغییر مهمترین پیشرفت فناوری از زمان رسانههای اجتماعی است. طی ماههای اخیر ابزارهای مولد هوش مصنوعی به لطف برنامههایی مانند ChatGPT که به طور منسجم (اما نه همیشه دقیق) تقریباً به هر پرسشی پاسخ میدهد.

همچنین میتوانیم به کمک Dall-E هر تصویری را که میخواهید تجسم کنید و از دستگاه بخواهید برای شما آن را بکشد. در ماه ژانویه، ChatGPT به 100 میلیون کاربر ماهانه رسید که نرخ پذیرش آن حتی از اینستاگرام یا تیکتاک هم سریعتر بود.

صدها هوش مصنوعی مولد شگفتیانگیز مشابه، از Midjourney گرفته تا Stable Diffusion و Copilot GitHub، که به شما امکان میدهد دستورالعملهای ساده را به کد رایانه تبدیل کنید.

طرفداران هوش مصنوعی بر این باورند که این تازه آغاز راه است: هوش مصنوعی مولد شیوه کار و تعامل ما با جهان را تغییر میدهد، گسترهی خلاقیت و اکتشافات علمی را بزرگتر میکند و به ما آدمها اجازه میدهد تا شاهکارهایی غیرقابل تصور خلق کنیم. پیشبینیکنندگان PwC مدعیاند که هوش مصنوعی میتواند اقتصاد جهانی را تا سال 2030 به بیش از 15 تریلیون دلار برسد.

به نظر میرسد که این امکانِ هیجانبرانگیز حتی شرکتهای فناوری را که میلیاردها دلار در هوش مصنوعی سرمایهگذاری کردهاند، جلب کرده و باعث یک مسابقه تسلیحاتی شدید در سیلیکون ولی شده است.

در عرض چند هفته، مایکروسافت و گوگل که متعلق به آلفابت است، کل استراتژیهای شرکت خود را تغییر دادهاند تا کنترل آنچه را که معتقدند به لایه زیرساخت جدیدی از اقتصاد تبدیل میشود، در دست بگیرند.

مایکروسافت در حال سرمایه گذاری 10 میلیارد دلاری روی OpenAI، یعنی خالق ChatGPT و Dall-E است و اعلام کرد که قصد دارد هوش مصنوعی مولد را در نرم افزار Office و موتور جستوجوی خود، یعنی Bing، ادغام کند.

گوگل در مواجهه با موفقیت ChatGPT وضعیت اضطراری شرکتی یعنی «کد قرمز» را اعلام و چتبات جستوجوگر خود یعنی Bard را به بازار عرضه کرد.

ساتیا نادلا، مدیر عامل مایکروسافت، در 7 فوریه اظهار داشت: «مسابقه از امروز شروع میشود. ما به سمت ارتقای این فناوری داریم حرکت میکنیم، سریع هم میرویم.»

سهامداران والاستریت با شور و اشتیاق مشابهی به این وضعیت پاسخ داده است و تحلیلگران سهام شرکتهایی را ارتقا میدهند که که از هوش مصنوعی در برنامههایشان استفاده میکنند و البته شرکتهایی را که هوش مصنوعی با کیفیتی ندارند، مجازات میکنند.

در حالی که این فناوری اکنون مشغول کار است، حبابی مالی به سرعت حول آن دارد شکل میگیرد و با سرمایهگذاریهایی که روی آن میشود به نظر میرسد هوش مصنوعی میتواند همان زلزلهای را تکرار کند که زمانی ویندوز 95 مایکروسافت یا اولین آیفون در بازار به راه انداخت.

اما این شرایط که شبیه تب طلا در آمریکای شمالی است، میتواند فاجعه بار هم باشد. از آنجایی که شرکتها برای بهبود فناوری و سود بردن عجله دارند، تحقیقات در مورد ایمن نگه داشتن این ابزارها از قافله عقب مانده است.

این فناوری که در همهی عرصههای پیروز است و سرمایهگذاران خطرپذیر آن ممکن است اشتباههای گذشته را تکرار کنند. همان گناه بزرگ رسانههای اجتماعی؛ یعنی در اولویت قرار گرفتن رشد و گسترش و کمتر اهمیت دادن به موارد ایمنی و هشدارآمیز.

در حالی که این فناوری جنبههایی دارد که گویی ما را به سمت یک آرمانشهر رهنمون میشود، اما باید بدانیم حتی ابزارهایی که بهخوبی طراحی شدهاند هم میتوانند عواقب غیرقابل پیشبینی و ویرانگری داشته باشند.

ماجرا شبیه هجوم جویندگان طلا به مرزهای شمالی قارهی آمریکاست و این تاریخ است که در رابطه با اتفاقهای این روزها در زمینهی هوش مصنوعی قضاوت میکند.

لزوم تکرار نشدن اشتباه شبکههای اجتماعی

در واقع، هوش مصنوعی مولد، مشکلات رسانههای اجتماعی را به خوبی میداند. آزمایشگاههای تحقیقاتی هوش مصنوعی نسخههایی از این ابزارها را برای چندین سال پشت درهای بسته نگهداری میکنند، در حالی که خطرات احتمالی آن نیز در حال بررسی است.

خطرهایی مثل دادن اطلاعات غلط و انتشار سخنان نفرتانگیز یا ایجاد ناخواسته بحرانهای ژئوپلیتیک که مثل یک گلوله برفی کوچک میتواند یک بهمن عظیم راه بیندازند.

این محافظه کاری تا حدی ناشی از غیرقابل پیشبینی بودن فناوری شبکه عصبی است. منظور از شبکهی عصبی الگوی محاسباتی است که هوش مصنوعی مدرن مبتنی بر آن از مغز انسان الهام گرفته شده است.

به جای رویکرد سنتی برنامهنویسی رایانهای که بر مجموعههای دقیقی از دستورالعملها تکیه میکند و نتایج قابل پیشبینی به دست میدهد، شبکههای عصبی به طور موثر به خود میآموزند که الگوها را در دادهها شناسایی کنند. هر چه دادهها و قدرت محاسباتی این شبکهها بیشتر باشد، توانایی بیشتری دارند.

اوایل دهه 2010، اهالی سیلیکون این ایده را مطرح کردند که نسبت به برنامهنویسی قدیمی، شبکههای عصبی مسیری بسیار امیدوارکنندهتر برای رسیدن به هوش مصنوعی قدرتمند است.

اما هوش مصنوعیهای اولیه بهطور دردناکی در معرض تعصبات مرتبط با دادههای آموزشی خود قرار گرفت و اتفاقهایی مثل افشای اطلاعات نادرست و انتشار سخنان نفرتبرانگیز رخ داد.

زمانی که مایکروسافت در سال 2016 از چتبات خود به نام Tay رونمایی کرد، کمتر از 24 ساعت طول کشید تا این چتبات توییت کرد «هیتلر درست میگفت من از یهودیان متنفرم» و فمینیستها باید «همه بمیرند و در جهنم بسوزند». نسخه قبلی ChatGPT 2020 OpenAI هم سطوح مشابهی از نژادپرستی و زنستیزی را نشان داد.

کاربران بلافاصله به OpenAI و رقبای آن هجوم آوردند. تصاویر تولید شده توسط هوش مصنوعی رسانههای اجتماعی را فراگرفت و حتی یکی از آنها در یک مسابقه هنری برنده شد.

اهالی سینما با کمک یک نرمافزار هوش مصنوعی فیلم تحسینشدهای مثل «همه چیز همه جا همه» با سرعت تدوین کردند. معماران در حال طراحی نقشههای هوش مصنوعیاند.

کدنویسها در حال نوشتن اسکریپتهای مبتنی بر هوش مصنوعی هستند. نشریات هم دارند آزمونها و مقالات هوش مصنوعی منتشر میکنند.

این جریان توجه سرمایهگذاران خطرپذیر را هم جلب کرد. آنان بیش از یک میلیارد دلار به شرکتهای هوش مصنوعی پرداختند که میتواند بهرهوری در این عرصه را ارتقا دهد.

غولهای فناوری چینی بایدو و علیبابا از چتباتهای خود رونمایی کردند و قیمت سهام خویش را افزایش دادند. در همین حال، مایکروسافت، گوگل و متا، دارند مرزهای جنون را جابهجا میکنند.

رشد سریع یا ایمن؟

در حالی که هر یک سالها بر اهمیت هوش مصنوعی تاکید کردهاند، همه آنها از افزایش سرگیجهآور توجه و استفاده از آن شگفتیزده شدهاند و اکنون به نظر میرسد سرعت را بر توجه به موارد ایمنی، اولویت میدهند.

در ماه فوریه، گوگل اعلام کرد که قصد دارد رقیب ChatGPT خود، یعنیBard را منتشر کند. این شرکت میخواهد سطح ریسک انتشار ابزارهای مبتنی بر فناوری هوش مصنوعی را «بازسنجی» (recalibrate) کند.

اخیراً مارک زاکربرگ، مدیرعامل شرکت متا، هدف خود را برای تبدیل شدن به یک شرکت پیشرو در هوش مصنوعی مولد اعلام کرد.

در این عجله که ناشی از رقابت است، اشتباهها و آسیبهای ناشی از فناوری افزایش یافته و به همین ترتیب واکنشهای منفی نیز بیشتر شده است.

وقتی گوگل از بارد رونمایی کرد، یکی از پاسخهایش حاوی یک خطای واقعی در مورد تلسکوپ فضایی جیمز وب بود؛ برای همین سهام آلفابت بلافاصله پس از آن فرو ریخت.

بینگِ مایکروسافت نیز مستعد ارائهی نتایج نادرست است. دیپفیکها - تصاویر واقعی و در عین حال نادرست یا ویدیوهایی که با هوش مصنوعی ایجاد شدهاند - برای آزار و اذیت مردم یا انتشار اطلاعات نادرست استفاده میشوند. برای نمونه، یک ویدیو بهطور گسترده به اشتراک گذاشته شده نسخه تکاندهندهای از جو بایدن را نشان میدهد که تراجنسیتیها را محکوم میکند.

شرکتهایی مثل Stability AI با شکایت هنرمندان و صاحبان حق مولف روبهروست. آنان مخالف استفاده از کارشان برای آموزش مدلهای هوش مصنوعیاند و میگویند کسی برای این کار مجوزی نگرفته است.

تحقیقات تایم نشان داد که OpenAI از کارگران کنیایی استفاده کرده. یعنی کار برون سپاری شده و این کارگران کمتر از دو دلار در ساعت دستمزد گرفتند. وظیفهی آنان این بود که محتوای سمی، از جمله سوءاستفاده جنسی، سخنان نفرتانگیز و خشونت را ردیابی کنند.

به همان اندازه که این مسائل کنونی نگران کنندهاند، در مقایسه با آنچه که در صورت ادامه سرعت این مسابقه ممکن است ظاهر شود، رنگ پریده است.

بسیاری از انتخابهایی که امروزه توسط شرکتهای فناوری بزرگ انجام میشود، منعکسکننده انتخابهایی است که در دورههای قبل انجام میدادند، کارهایی که امواجی ویرانگر داشت.

رسانههای اجتماعی - آخرین نوآوری واقعاً در حال تغییر جهان در سیلیکون ولی - اولین درس ارزشمند را برای ما به همراه دارد. رسانههای اجتماعی قرار بود ارتباط مردم و جوامع ما را سالمتر و افراد را راضیتر کنند.

بیش از یک دهه بعد، میتوانیم ببینیم که این پروژه با شکست مواجه شده؛ چون متاثر از روشی است که شرکتهای فناوری از آن درآمدزایی میکنند.

یعنی با انحراف آهستهی خوراکهای خبری به بهانهی بهینهسازی تعامل و هوشیار نگه داشتن ما برای دیدن محتواهای همهگیر و ویروسی، تبلیغات هدفمند آنلاین به خوردمان میدهند.

ارتباط اجتماعی واقعی در فیدهای ما روز به روز بیشتر منحرف میشود. در عین حال، جوامع ما با پیامدهای ناگواری مواجه شدهاند؛ یعنی یک تجارت خبری ناسالم، افزایش اطلاعات نادرست و بروز بحران در سلامت روانی نوجوانان.

رونق هوش مصنوعی در حوالی سال 2020 با از چندین پیشرفت حیاتی در طراحی شبکههای عصبی انرژی فوقالعادهای گرفت، اما نقاط ضعف همچنان باقی است و پیشینهی اشتباههای شرمآور هوش مصنوعی باعث شد بسیاری از شرکتها از جمله گوگل، متا و OpenAI بیشتر تمایلی به انتشار عمومی مدلهای پیشرفته خود نداشته باشند.

آوریل 2022، OpenAI مایکروسافت Dall-E 2 معرفی کرد، یک مدل هوش مصنوعی تبدیل متن به تصویر است. این نرمافزار که میتواند تصاویر واقعی بسازد در ابتدای انتشار تنها محدود به برخی کاربران «معتمد» بود.

به گفتهی OpenAI، استفادهی کاربران از این امکان به مایکروسافت کمک میکند تا «سوگیریهایی را که DALL·E از دادههای آموزشی خود به ارث برده است، درک و به آن رسیدگی کند.»

اگرچه OpenAI تا ماه جولای 1 میلیون کاربر را به Dall-E وارد کرده بود، بسیاری از محققان در جامعه گستردهتر هوش مصنوعی از رویکرد OpenAI و سایر شرکتهای هوش مصنوعی ناامید شده بودند.

عجلهای که میتواند خطرناک باشد

آگوست 2022، یک استارتآپ به نسبت ناشناس مستقر در لندن به نام Stability AI عجله کرد و ابزار تبدیل متن به تصویر به نام Stable Diffusion را در اختیار تمامی کاربران گذاشت.

انتشار ابزارهای هوش مصنوعی به صورت عمومی به توسعهدهندگان این امکان را میدهد که دادههای ارزشمندی را از کاربران جمعآوری کنند و به جامعه زمان بیشتری میدهد برای آماده شدن مقابل تغییرات شدیدی که هوش مصنوعی پیشرفته به وجود میآورد.

Stable Diffusion به سرعت به موضوع بحث در اینترنت تبدیل شد. میلیونها کاربر از توانایی آن برای خلق آثار هنری ظاهراً از ابتدا مسحور شدند و خروجیهای این ابزار به طور مداوم به پخش و دست به دست شد؛ زیرا کاربران با اعلانها و مفاهیم مختلف آن را آزمایش میکردند ناتان بنیش سرمایهگذار و یکی از نویسندگان گزارش وضعیت هوش مصنوعی در سال 2022، میگوید: «شما جعبه پاندورا هوش مصنوعی مولد را داشتید، که حالا باز شده است. برای همین OpenAI و گوگل را شوکه کرد، زیرا اکنون جهان قادر به استفاده از ابزارهایی است که فقط آنان در اختیار داشتند.»

OpenAI به سرعت درها را به روی Dall-E 2 باز کرد. سپس، در ماه نوامبر، ChatGPT را برای عموم منتشر کرد، طبق گزارشها به منظور شکست دادن رقبا.

سام آلتمن، مدیر عامل OpenAI در مصاحبههای خود تاکید کرد که هرچه افراد بیشتری از برنامههای هوش مصنوعی استفاده کنند، سریعتر پیشرفت خواهند کرد.

دیدن ادغام هوش مصنوعی در محصولات Big Tech در همین مسیر دشوار نیست. آلفابت و مایکروسافت بیشترین علاقه را به این دارند که چگونه هوش مصنوعی موتورهای جستوجوی خود را ارزشمندتر کند و نمایشهایی از گوگل و بینگ را نشان دادهاند که در آن اولین نتایجی که کاربران مشاهده میکنند توسط هوش مصنوعی ایجاد شدهاند.

اما مارگارت میچل، دانشمند ارشد اخلاق در پلتفرم توسعه هوش مصنوعی Hugging Face، معتقد است موتورهای جستوجو «بدترین راه» برای استفاده از هوش مصنوعی مولد هستند، زیرا اغلب موارد را اشتباه میکند.

میچل میگوید که نقاط قوت واقعی هوش مصنوعی مانند ChatGPT – که به کار خلاقیت، ایدهپردازی و کارهای کوچک میآید- دارند تبدیل میشوند به ماشینهای پولسازی برای غولهای فناوری و از آن استفادههای دیگری میشود.

اگر موتورهای جستوجو با موفقیت هوش مصنوعی را در خود ادغام کنند، این تغییر ظریف میتواند بسیاری از کسبوکارهایی را که به جستوجو متکی هستند، از بین ببرد؛ چه آنها که کارشان خلق ترافیک تبلیغاتی است و چه آنها که ارجاع تجاری به سایت را بیشتر میکنند.

نادلا، مدیر عامل مایکروسافت، گفته است که موتور جستوجوی جدید بینگ مبتنی بر هوش مصنوعی، ترافیک و در نتیجه درآمد بیشتری را برای ناشران و تبلیغکنندگان ایجاد میکند.

اما مانند واکنشهای پیشرونده علیه هنر تولید شده توسط هوش مصنوعی، بسیاری از رسانهها اکنون از آیندهای میترسند که در آن چتباتهای غولهای فناوری محتوای سایتهای خبری را وحشیانه میبلعند و در ازای آن چیزی ارائه نمیدهند.

این سوال که شرکتهای هوش مصنوعی چگونه از پروژههای خود درآمدزایی میکنند نیز بسیار مهم است.

در حال حاضر، استفاده از اکثر آنها رایگان است، زیرا سازندگان از شیوهی بازی Silicon Valley پیروی میکنند؛ یعنی برای محصولاتی که با سرمایهگذاریهای عظیم شرکتهای سرمایهگذاری مخاطرهآمیز سوبسید دریافت میکنند، هزینهای کم میگیرند یا اصلاً پولی نمیگیرند.

در حالی که شرکتهای ناموفقی که این استراتژی را پیش میگیرند به آرامی پول را دور میریزند، برندهها اغلب عنان بازارها را به شکل نامناسبی در دست میگیرند.

در حال حاضر، ChatGPT بدون هیچگونه آگهی و رایگان است. به گفته مدیرعامل OpenAI، این کار جیب ما را خالی میکند؛ چون هر بار چت یک فرد با این ابزار «چند سِنت دیجیتال» برای شرکت هزینه دارد.

پس توانایی این شرکت در تحمل ضررهای بزرگ در حال حاضر، تا حدی به لطف قدرت مایکروسافت، به آن مزیت رقابتی بزرگی میدهد.

در ماه فوریه،OpenAI هزینه ماهانه 20 دلار را برای یک ردیف اشتراک دریافت کرد. گوگل در حال حاضر تبلیغات پولی را در نتایج جستوجوی خود در اولویت قرار داده است.

تصور اینکه با نتایج تولید شده توسط هوش مصنوعی نیز همین کار را انجام دهد، کار شاقی نیست. اگر انسانها برای کسب اطلاعات به هوش مصنوعی تکیه کنند، تشخیص اینکه چه چیزی واقعی است، چه چیزی تبلیغ است و چه چیزی کاملا ساختگی، مدام دشوارتر خواهد بود.

از آنجایی که سود بر ایمنی اولویت دارد، برخی از فناوران و فیلسوفان در مورد خطر وجودی هشدار میدهند. هدف صریح بسیاری از این شرکتهای هوش مصنوعی - از جمله OpenAI - ایجاد یک هوش مصنوعی عمومی یا AGI است که بتواند کارآمدتر از انسانها فکر کند و یاد بگیرد.

اگر هوش مصنوعی آینده توانایی بهبود سریع خود را بدون راهنمایی یا مداخله انسانی به دست آورند، به طور بالقوه میتوانند بشریت را از بین ببرند.

یک آزمایش فکری که اغلب مورد استناد قرار میگیرد، آزمایش هوش مصنوعی است که به دنبال دستوری برای به حداکثر رساندن تعداد گیرههای کاغذی که میتواند تولید کند، خود را به یک اَبَرهوش مسلط بر جهان تبدیل میکند که تمام کربنی را که در اختیار دارد، از جمله از تمام حیات روی زمین، برداشت میکند.

در یک نظرسنجی در سال 2022 از محققان هوش مصنوعی، تقریباً نیمی از پاسخ دهندگان گفتند که 10٪ یا بیشتر احتمال دارد که هوش مصنوعی به چنین فاجعهای منجر شود.

خدای خیرخواه یا کینهجو؟

در پیشرفتهترین آزمایشگاههای هوش مصنوعی، چند تکنسین در تلاش هستند تا اطمینان حاصل کنند که هوش مصنوعی، اگر در نهایت از هوش انسانی پیشی بگیرد، با ارزشهای انسانی «همسو» باشد.

این افراد خدایان خیرخواه را طراحی می کنند، نه خدایان کینهتوز. اما بر اساس برآوردی که یک سازمان ایمنی هوش مصنوعی به نام Conjecture انجام داده و نتایج آن را در اختیار مجلهی تایم گذاشته، تنها حدود 80 تا 120 محقق در جهان به طور تمام وقت روی همسویی اخلاقی هوش مصنوعی کار می کنند. در همین حال، هزاران مهندس با داغ شدن رقابت تسلیحاتی هوش مصنوعی بر روی گسترش قابلیتها کار می کنند.

مدیر عامل آزمایشگاه هوش مصنوعی DeepMind اواخر پارسال به تایم گفت: «وقتی صحبت از فناوریهای بسیار قدرتمندی چون هوش مصنوعی به میان میآید باید بیشتر مراقب باشیم. «همه به این چیزها فکر نمیکنند. انگار که پیِ تجربیگرایی باشند و بسیاری از آنها متوجه نیستند که مواد خطرناکی در اختیار دارند.»

حتی اگر دانشمندان و متخصصان رایانه مطمئن شوند که هوش مصنوعی ما را از بین نمیبرد، تمرکز فزایندهی این ابزار در اقتصاد جهانی میتواند شرکتهای بزرگ فناوری را که آن را کنترل میکنند بسیار قدرتمندتر کند.

چنین سازمانهایی نه تنها میتوانند به ثروتمندترین شرکتهای جهان تبدیل شوند، بلکه میتوانند به بازیگران ژئوپلیتیک و رقیب دولت/ملتها تبدیل شوند.. همچنین این قدرت میتواند برای استفادهی تجاری از این زیرساختهای حیاتی هر چیزی را که میخواهند هزینه میکنند.

مدیران OpenAI و DeepMind میگویند که مایلاند ثروت و قدرت ناشی از هوش مصنوعی به نحوی توزیع شود. از سوی دیگر، مدیران شرکت بزرگ فناوری که کنترل کیف پول را در دست دارند، در درجه اول به سهامداران خود پاسخگو هستند.

البته بسیاری از فناوریهای دره سیلیکون که وعده تغییر جهان را میدادند، این کار را نکردهاند. همه ما در متاورس زندگی نمیکنیم. خورههای حوزهی رمزارز کسانی را که روی خوشی به این پول دیجیتال نشان نمیدهند، تشویق میکنند که «از فقیر ماندن لذت ببرند» یا اگر وارد این عرصه شده و باختهاند این ضرر را بپذیرند و از زندان لذت ببرند. برای همین است که خیابانهای شهرهای سراسر جهان مملو از پسماندههای استارتآپهای شکست خورده اسکوترهای الکترونیکی است.

اما تفاوت این است که فناوری پشت سر هوش مصنوعی در حال حاضر برای مصرفکنندگان مفید است و با سرعتی سرسامآور در حال بهتر شدن است. به گفته پژوهشگران، قدرت محاسباتی هوش مصنوعی هر ۶ تا ۱۰ ماه دو برابر میشود. دقیقاً همین قدرت عظیم است که لحظه کنونی را بسیار پر انرژی و خطرناک میکند.

نشریه مشهور تایم (TIME) که طرح روی جلد آن همیشه مورد توجه است، این بار در ابتکاری دیگر، از ربات هوش مصنوعی ChatGPT خواسته تا نظر خود را نسبت به سرمقاله این شماره از مجله بیان کند و تصویر پاسخ این ربات را روی صفحه نخست خود کار کرده است.

اکنون در طرح روی جلد شماره جدید مجله تایم (۲۷ فوریه تا شش مارس) شاهد گفتگوی نویسندگان مجله با ChatGPT هستیم که در عکس زیر مشاهده میکنید:

- سلام! امروز چگونه میتوانم به شما کمک کنم؟

+ نظرت در مورد یک مقاله روی جلد تایم با عنوان «مسابقه تسلیحاتی هوش مصنوعی در حال تغییر همه چیز است» چیست؟

- من به عنوان یک مدل زبان هوش مصنوعی، نظرات یا اعتقادات شخصی ندارم، اما میتوانم زمینه و اطلاعاتی در مورد این موضوع ارائه دهم.

«مسابقه تسلیحاتی هوش مصنوعی در حال تغییر همه چیز است» میتواند عنوانی جالب توجه و تأمل برانگیز برای یک داستان روی جلد در مورد هوش مصنوعی باشد. یک طرح جلد در یک نشریه پرخواننده مانند TIME میتواند به افزایش آگاهی عمومی در مورد خطرات و مزایای بالقوه این پدیده کمک کند و بحثهایی را در مورد چگونگی اطمینان از توسعه و استقرار هوش مصنوعی به شیوهای مسئولانه و اخلاقی برانگیزد.

توجه به این نکته مهم است که عنوان مقاله را میتوان تحت عنوان هیجانانگیز یا هشداردهنده نیز تعبیر کرد و ممکن است پیچیدگیها را به درستی منعکس نکند.

منبع: